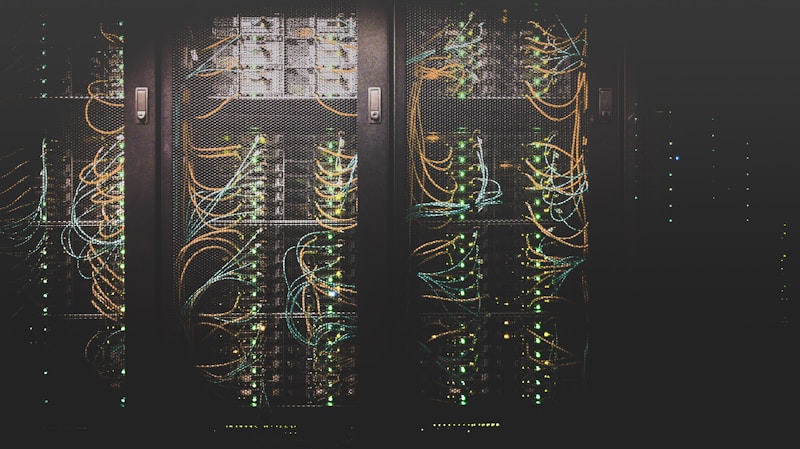

dbt + Airflow: cómo estructuramos pipelines de datos para clientes institucionales

El caos que vive dentro de cada pipeline de datos

La mayoría de las empresas tienen datos. Pocas tienen datos confiables, documentados, y listos para ser usados en decisiones. El gap entre "tenemos datos" y "podemos confiar en nuestros datos" es donde viven la mayoría de los proyectos fallidos de IA.

Cuando llegamos a un nuevo cliente, lo primero que hacemos es auditar su stack de datos. En más del 80% de los casos encontramos lo mismo: transformaciones SQL sin documentar, pipelines que nadie sabe exactamente qué hacen, y definiciones de métricas que varían entre equipos.

Por qué dbt cambió la forma en que pensamos las transformaciones

dbt (data build tool) introduce el concepto de software engineering al mundo de las transformaciones de datos. Versioning, testing, documentación automática, linaje de datos. En lugar de scripts SQL sueltos que viven en bases de datos o en máquinas locales, tenés modelos con dependencias explícitas, tests definidos y un grafo de transformaciones visible.

La clave de dbt no es la tecnología — es la disciplina que impone. Cuando cada transformación tiene un test asociado, el equipo deja de preguntarse "¿están bien estos números?" y empieza a confiar en el pipeline.

Dónde entra Airflow

dbt transforma datos. Airflow orquesta cuándo y en qué orden se ejecutan esas transformaciones. La combinación es poderosa: Airflow maneja la lógica de scheduling, reintentos, dependencias entre DAGs y alertas. dbt maneja la lógica de las transformaciones con todo el rigor de ingeniería de software.

En proyectos de clientes institucionales, donde los pipelines pueden tener 50 o 100 modelos dbt con dependencias cruzadas, Airflow es lo que permite operar eso con confianza a escala.

El patrón que recomendamos

Organizamos los modelos dbt en capas: staging (limpieza de fuentes), intermediate (transformaciones de negocio), y marts (tablas listas para consumo). Cada capa tiene sus tests. Los DAGs de Airflow ejecutan las capas en orden y alertan ante cualquier fallo antes de que llegue a producción.

El resultado: equipos de datos que duermen tranquilos y analistas que confían en los números que ven en su dashboard.

¿Te resultó útil? Compartilo.

Compartir en LinkedIn